このサイトの紹介

このサイトについて

https://api.openai.com を置き換えるか、後でドキュメント内のパスを接続するだけで済みます。https://api.ohmygpt.com安定、高速 CDN、米国以外の地域に推奨、グローバル アクセラレーション (中国本土では利用できません): https://apic.ohmygpt.com※高品質回線逆生成1「高品質回線」:

https://www.aigptx.top※高品質回線逆生成2「高品質回線」:

https://cn2us02.opapi.winストリーミング API 呼び出しを使用する場合、Cloudflare のこの制限の影響を受けません。

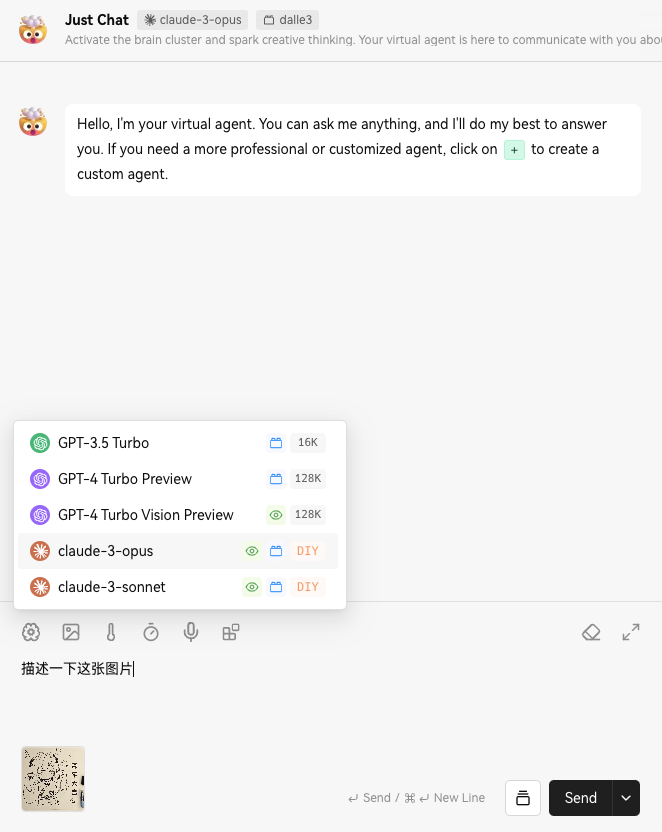

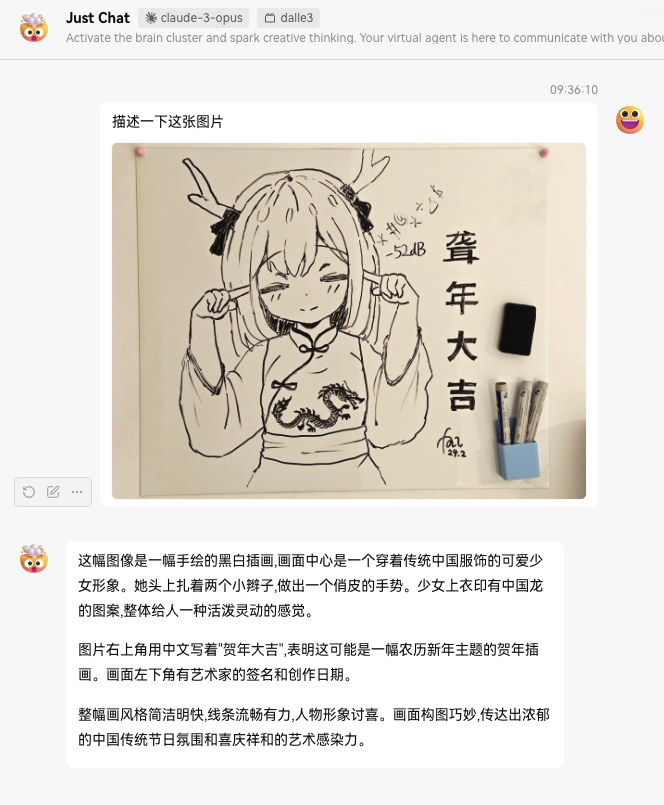

画像入力でマルチモーダル モデルを使用するにはどうすればよいですか?

ローブチャット

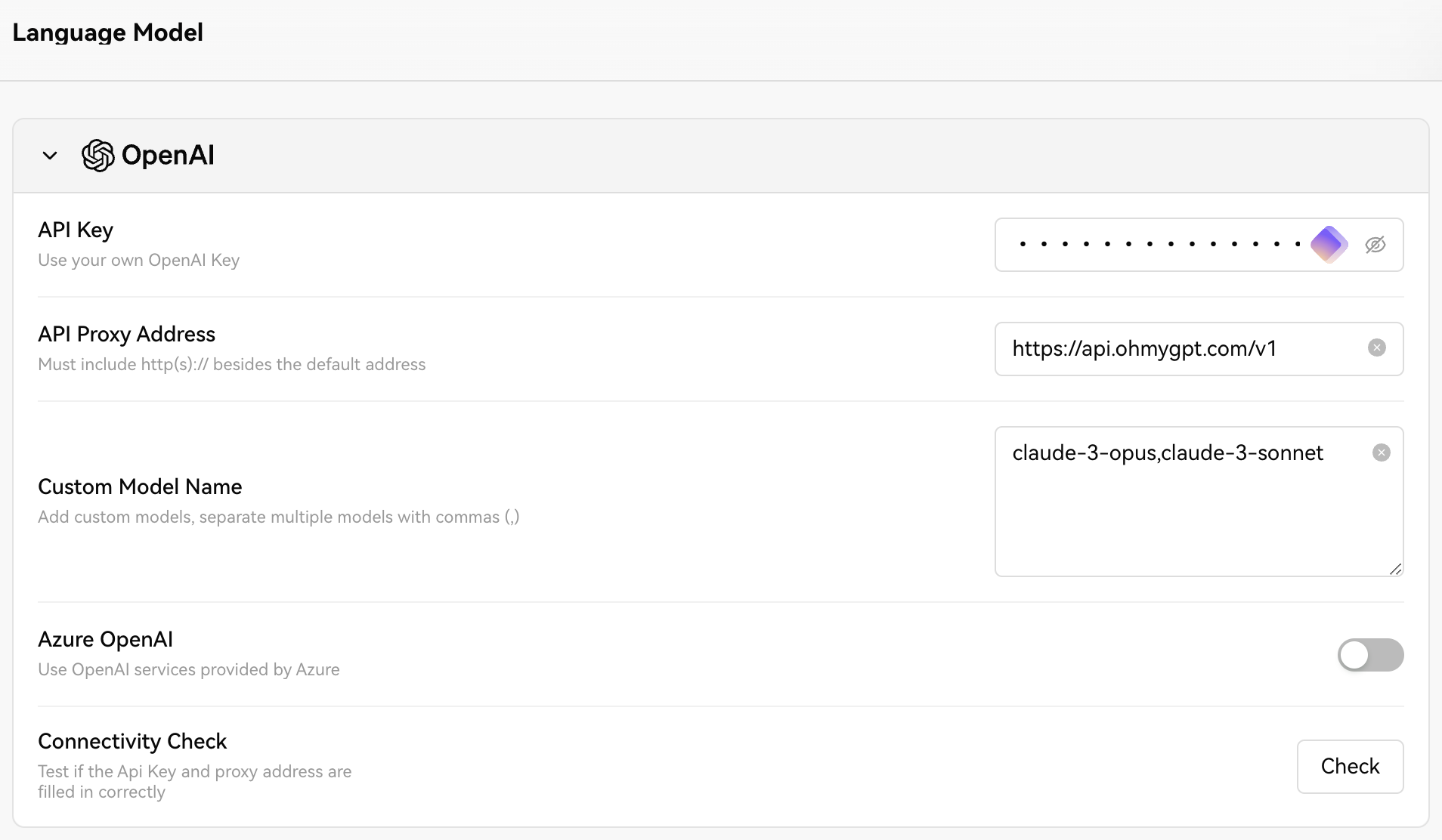

https://api.ohmygpt.com/v1 を入力します

ボットジェム(AMA)

このサイトで自分の openai キーを直接使用できますか?

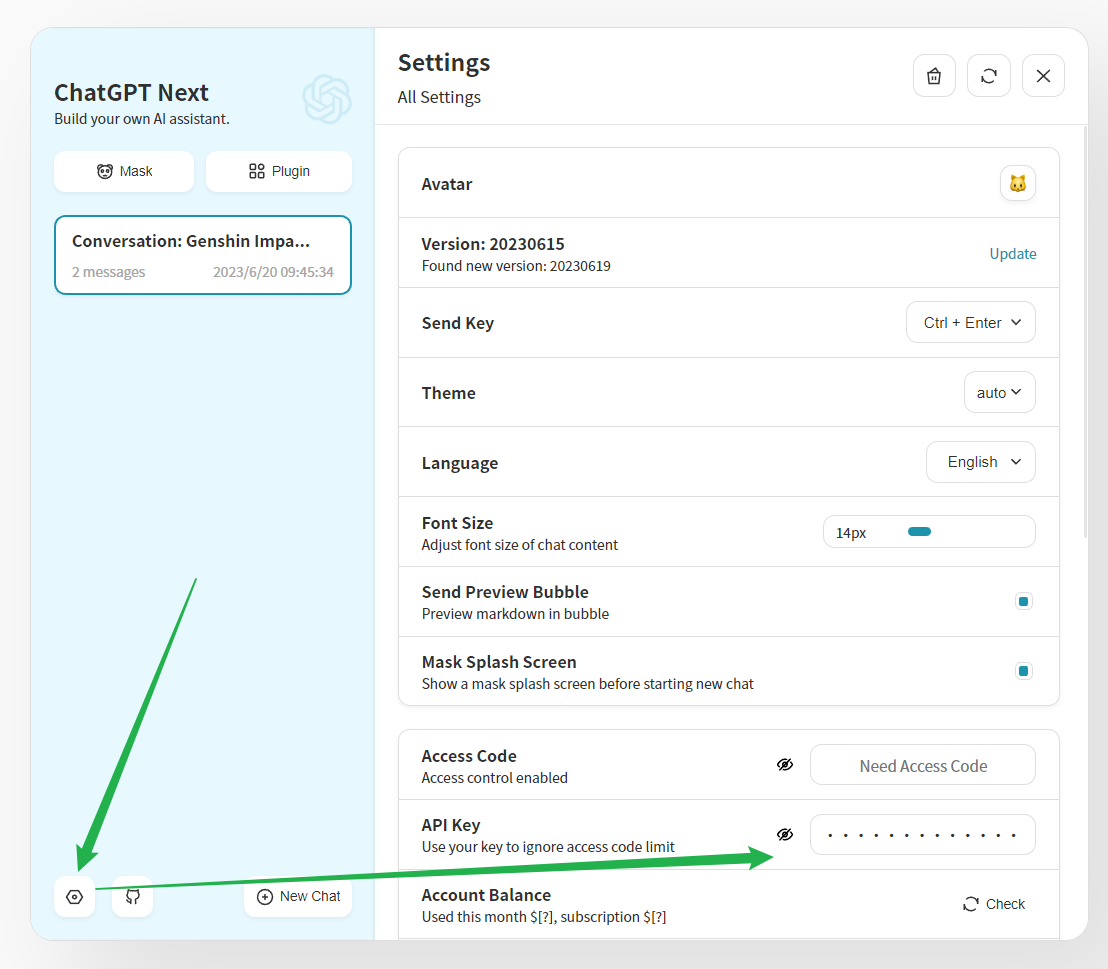

chatGPT-next-web でこのサイトのサービスを使用するにはどうすればよいですか?

GPT アカデミック最適化でこのサイトのサービスを使用するにはどうすればよいですか?

1.

2.

{"https://api.openai.com/v1/chat/completions": "https://aigptx.top/v1/chat/completions"} に変更します。GPT アカデミック最適化でこのサイトの Claude2 サービスを使用するにはどうすればよいですか?

1.

2.

{"https://api.openai.com/v1/chat/completions": "https://aigptx.top/v1/chat/completions"} に変更します。3.

4.

「」パイソン

llm_model.startswith('gpt-') または llm_model.startswith('claude-2-w') の場合:

「」

インデントに注意してください

5.

「」パイソン

"クロード-2-ウェブ": {

"fn_with_ui": chatgpt_ui、

"fn_without_ui": chatglm_noui、

「エンドポイント」: openai_endpoint,

"max_token": 8196、

「トークナイザー」: tokenizer_gpt35,

"token_cnt": get_token_num_gpt35,

}

「」

その後、claude2 モデルを使用できます。 Web で claude-2-web を選択して使用します。

メンバーと GPT4 について

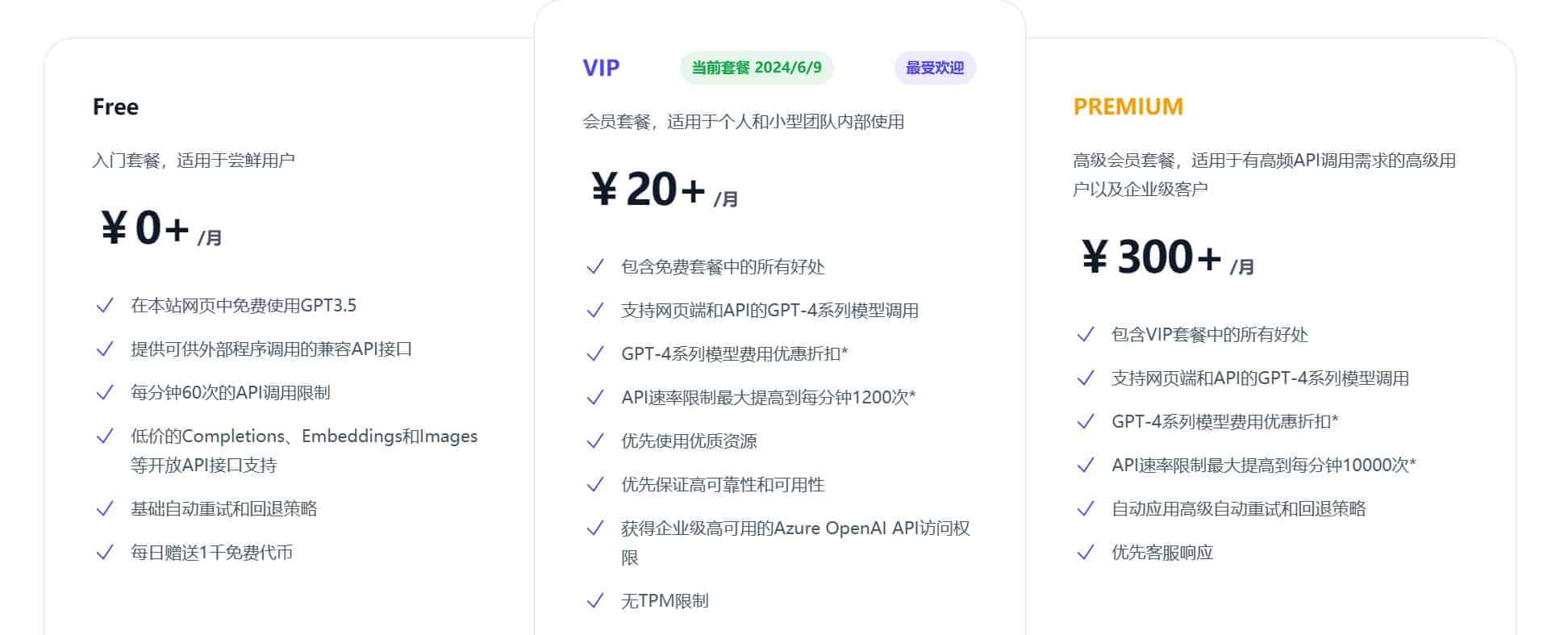

GPT4 の使用許可を取得するにはどうすればよいですか?

VIP パッケージは月額パッケージですか?

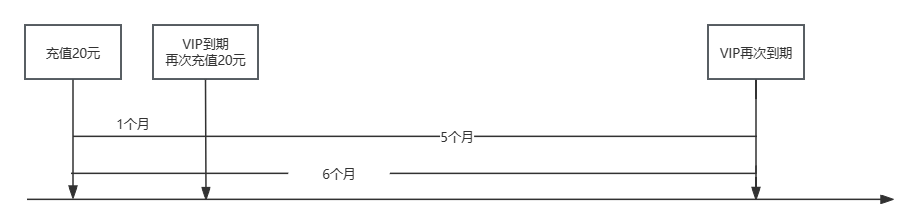

20元チャージしたらVIP資格が失効してしまいました。さらに 20 元をチャージすると、いつまで VIP 特典を獲得できますか?

OhMyGPT.com にアクセスできません。ウェブサイトのサービスがダウンしていますか?

https://status.ohmygpt.com/status/main

または

https://status.aigptx.top/status/main

コスト消費について

支出の計算方法は?

請求表の各列は何を表しますか?

※RURTリクエストのアップロード時間(単位:ミリ秒)

※TPSリクエスト時間(単位:秒)

プロンプトトークンと完了トークンとは何ですか?

Web バージョンを使用すると、プロンプトトークンが非常に多くなるのはなぜですか?

Web バージョンにはユーザーとモデルに加えてシステム ロールがあるのはなぜですか?

APIについて

私は初心者なのですが、サービスを呼び出すためのコード例を教えていただけますか?

まず、キーを準備する必要があります

「」パイソン

リクエストをリクエストとしてインポートする

このサイトの API_KEY をここで設定します

「認可」: 'Bearer' + api_key、

}

「メッセージ」: [

"役割": 'ユーザー',

「内容」:質問

}

]、

モデルを切り替える必要がある場合は、ここで変更してください

}

応答 = リクエスト.post(

"https://aigptx.top/v1/chat/completions",

ヘッダー=ヘッダー、

json=パラメータ、

ストリーム=偽

)

res = 応答.json()

res_content = res['選択'][0]['メッセージ']['コンテンツ']

print(res_content)

修改于 2025-10-15 08:05:43